Die Qualität der SMD-Bestückung (Surface Mount Device) entscheidet über Leistungsfähigkeit, Zuverlässigkeit und Langlebigkeit elektronischer Systeme. Zentrale Bausteine der Qualitätssicherung in der Elektronikfertigung sind Verfahren wie die Lötpasteninspektion (SPI) und die automatisierte optische Inspektion (AOI). Obwohl beide Prozesse präzise Ergebnisse liefern, arbeiten sie bislang weitgehend getrennt voneinander. So werden Fehler – etwa im Lotpastendruck – oft zu spät erkannt und nicht prozessübergreifend interpretiert.

In seiner Masterarbeit untersucht Karim Shousha von der Arbeitsgruppe »Photonic and Plasmonic Systems« am Fraunhofer IZM, wie sich durch eine KI-gestützte Analyse von SPI- und AOI-Daten ein zusammenhängender Inspektionsworkflow realisieren lässt, der Defekte in der Leiterplattenbestückung nicht nur erkennt, sondern auch nachvollziehbar erklärt.

Dafür prüfte er verschiedene KI-Modelle – von klassischer Bilderkennung über Large Language Models (LLMs) bis hin zu multimodalen Lösungen – hinsichtlich ihrer Eignung für eine prozessübergreifende Fehleranalyse. Seine Untersuchungen führten zu klaren Aussagen zur praktischen Umsetzbarkeit und zur passenden Modellauswahl.

Im Interview mit RealIZM gibt er Einblicke in seine Ergebnisse und zeigt auf, welches Potenzial KI-gestützte Inspektionsverfahren für die SMD-Bestückung bieten könnten.

RAG-gestützte Pipeline für SPI- und AOI-Daten

Fertigungsfehler im Lötprozess – z. B. Brückenbildungen, Hohlräume oder Bauteilverschiebungen – zählen zu den häufigsten Ursachen für Ausfälle in der Elektronikfertigung.

Zirka 70 Prozent der Fertigungsfehler entstehen im Lötprozess. | © Fraunhofer IZM | Biemans: 5D solder paste inspection-merits beyond 3D technology. In: Global SMT & Packaging (2011), S. 8.

Mit dem Fokus auf der Lötpasteninspektion (SPI – Solder Paste Inspection) und der automatisierten optischen Inspektion (AOI – Automated Optical Inspection) hat Karim Shousha eine KI-gestützte Pipelinearchitektur entworfen, die beide Prüfverfahren zu einem integrierten Workflow vereint. Dadurch lässt sich die Qualität und Zuverlässigkeit bestückter Leiterplatten steigern und ihre Lebensdauer erhöhen.

Die zentrale Erkenntnis seiner Forschungsarbeit: Der vielversprechendste Ansatz für die Inspektion bei der industriellen Bestückung von Leiterplatten ist weder ein klassisches Bildverarbeitungsmodell noch ein großes Cloud-basiertes KI-System, sondern ein kompaktes, lokal betreibbares KI-Modell, das mithilfe von Retrieval-Augmented Generation (RAG) gezielt um domänenspezifisches Wissen erweitert wird.

Den Kern der Pipeline bildet das Vision-Language-Model (VLM) Qwen3-VL-8B, das im Herbst 2025 veröffentlicht wurde. Als multimodales KI-Modell kann es hochaufgelöste Bilddaten gemeinsam mit textlichen Informationen verarbeiten und interpretieren. Es erkennt elektronische Bauteile, analysiert deren Position auf der Leiterplatte und Fehler präzise.

Durch die RAG-Erweiterung kann das System zudem vor der Analyse auf IPC-Normen, Gerber-Daten und prozessspezifische Metadaten zurückgreifen. So lassen sich industrielle Qualitätsanforderungen zuverlässig bewerten – ein Vorteil, der mit rein datengetriebenen Modellen allein nicht erreichbar wäre.

Deep Learning als Basis: Stärken und Schwächen

Die heutige KI-Landschaft ist von einer Vielzahl an Modellen geprägt, die sich im Wesentlichen entlang zweier Dimensionen unterscheiden: ihren Fähigkeiten (z. B. Detektion, Verstehen und Schlussfolgern) sowie ihrer Größe – dem Umfang der verwendeten Trainingsdaten und Parameter. »Um einen geeigneten Ansatz für die automatisierte Erkennung und Klassifizierung von PCB-Komponenten zu bestimmen, war es daher wichtig, verschiedene KI-Modellklassen systematisch zu untersuchen«, erläutert Shousha seinen Ansatz.

Im Fokus standen Deep-Learning-Modelle: Sie bilden eine Unterkategorie des maschinellen Lernens und basieren auf mehrschichtigen künstlichen neuronalen Netzen, die Muster direkt aus großen Datensätzen lernen, statt fest programmierten Regeln zu folgen. Deep Learning bildet die Grundlage vieler moderner KI-Verfahren, etwa in der Bild- und Spracherkennung oder der Textverarbeitung.

Gerade bei den für das Modelltraining benötigten Datensätzen liegt die zentrale Herausforderung. Karim Shousha betont: »Die Aussagekraft von Deep-Learning-Systemen ist unmittelbar an die verwendeten Trainings- und Testdatensätze gebunden. Da diese häufig proprietär und damit intransparent sind, kann in spezialisierten Domänen wie der Elektronikherstellung weder von einer vollständigen Datenabdeckung noch von einer uneingeschränkt nachvollziehbaren Validierung der Testergebnisse ausgegangen werden.«

Modellvergleich: YOLO, Zero-Shot und Großmodelle

Der mehrstufige Testprozess umfasste verschiedene Deep-Learning-Modelle – von spezialisierteren, aufgabenspezifischen Ansätzen bis hin zu allgemeineren und leistungsfähigeren Architekturen. Den Anfang bildeten YOLO-basierte Modelle (»You Only Look Once«), die durch ihre visuelle Objekterkennung eine effiziente Lokalisierung von Bauteilen ermöglichen. Ihre Schwäche liegt jedoch in der Abhängigkeit von umfangreichen, annotierten Datensätzen.

Vergleich von vier getesteten KI-Modellen | © Fraunhofer IZM

Trefferquote und Genauigkeit der einzelnen getesteten KI-Modelle | © Fraunhofer IZM

Shousha untersuchte im nächsten Schritt Zero-Shot-Vision-Language-Modelle. Diese verknüpfen visuelle Inhalte mit textuellen Beschreibungen und erkennen Objekte ohne explizites task-spezifisches Training. Obwohl sie auf Vision-Language-Architekturen basieren, die Bild- und Textinformationen gemeinsam verarbeiten, stoßen sie an Grenzen, wenn die Daten im Vortraining die Zieldomäne – etwa den Elektronik- bzw. PCB-Bereich – nicht ausreichend abdecken. Abschließend testete Shousha großskalige Modelle – Large Language Models (LLMs) und Visual Language Models (VLMs).

Große versus kleine KI-Modelle: Leistung, Kosten und Datenschutz

Die Größe eines KI-Modells wird über die Anzahl seiner Parameter bestimmt – jener trainierbaren Gewichte, mit denen Muster in Daten erlernt werden. Kleine KI-Modelle verfügen über rund 1 bis 10 Milliarden Parameter. Während große KI-Modelle mit bis zu 500 Milliarden Parametern und mehr arbeiten. LLMs und VLMs dieser Größenordnung bieten eine hohe Leistungsfähigkeit im Erkennen und Schlussfolgern. Die Kehrseite der Medaille besteht darin, dass sie entsprechend mehr Rechenleistung fordern und damit zu einem höheren Ressourcenverbrauch sowie höheren Betriebs- und Interferenzkosten führen.

Darüber hinaus spielen Aspekte der Datensicherheit und Zuverlässigkeit eine wichtige Rolle: Große KI-Modelle werden über Clouds bereitgestellt. Dies erschwert den Umgang mit sensiblen Produktionsdaten und stellt zusätzliche Sicherheitsanforderungen. Auch sogenannte Halluzinationen stellen ein Problem dar: Mit einem meist hohen Maß an Überzeugung können KI-Modelle falsche oder nicht überprüfbare Aussagen generieren. Oft liegt das an Faktoren wie mehrdeutigen Vorgaben oder fehlenden Datengrundlagen.

Vor diesem Hintergrund scheinen für die Lohnbestücker lokal betriebene, abgeschlossene KI-Systeme am geeignetsten zu sein, wie Karim Shousha erklärt: »Der Schutz sensibler Fertigungsdaten hat eine hohe Priorität. Viele Unternehmen bevorzugen daher geschlossene Netzwerke. Zudem sind solche Lösungen auch wirtschaftlich vorteilhaft, da der Betrieb großer KI-Modelle, die mit Milliarden von Parametern trainiert wurden, mit erheblichen Kosten verbunden ist und sich in der Praxis kaum effizient skalieren lässt.«

Allerdings bringt auch der Einsatz kleinerer KI-Modelle Einschränkungen mit sich: Sie sind einfacher zu implementieren und kostengünstiger im Betrieb. Im Vergleich zu großen KI-Modellen weisen sie jedoch eine häufig geringere Leistungsfähigkeit auf.

Optimierter Inspektions-Workflow durch RAG

Der notwendige Kompromiss zwischen Datensouveränität und Systemperformance, der bei der Nutzung kleinerer KI-Modelle mit begrenzter Kapazität und fehlendem Domänenwissen sichtbar wird, kann durch die Implementierung einer RAG umgangen werden. Die Tests des bestehenden Prüf-Workflows zeigten, dass sich so ein Mittelweg zwischen hoher Modell-Performance und praktischer Einsetzbarkeit realisieren lässt. So können auch kompakte VLMs wie z. B. Qwen3-VL-8B so erweitert werden, dass sie bei der Leiterplatteninspektion nahezu die gleiche Leistungsfähigkeit deutlich größerer KI-Modelle erreichen. Dieser Ansatz ist für die SMD-Bestückung besonders vielversprechend und lässt sich problemlos in bestehende SPI-/AOI-Linien integrieren.

Vereinfachte Darstellung: Workflow von der Bildverarbeitung bis zur Verarbeitung des KI-Modells | © Fraunhofer IZM

»Der zentrale Vorteil dieser Pipeline«, erklärt Karim Shousha, »ist, dass sie Defekte nicht nur erkennt, sondern auch deren Ursachen erklärt. Die KI-gestützte Datenauswertung zeigt auf, in welchem Prozessschritt die Defekte auftreten und eröffnet die Möglichkeit, Just-in-Time-Korrekturen im Fertigungsprozess vorzunehmen.« Langfristig könnten Elektronik-Fertigungsdienstleister so von einer Echtzeitüberwachung in einer Live-Produktionsumgebung profitieren, in der Fehler sofort nach ihrem Auftreten erkannt und behoben werden können.

»Ursachenerkennung statt nur Detektion: Eine KI‑gestützte Datenauswertung […] eröffnet die Möglichkeit, Just‑in‑Time‑Korrekturen im Fertigungsprozess vorzunehmen.«

Karim Shousha, Studentischer Mitarbeiter, Fraunhofer IZM

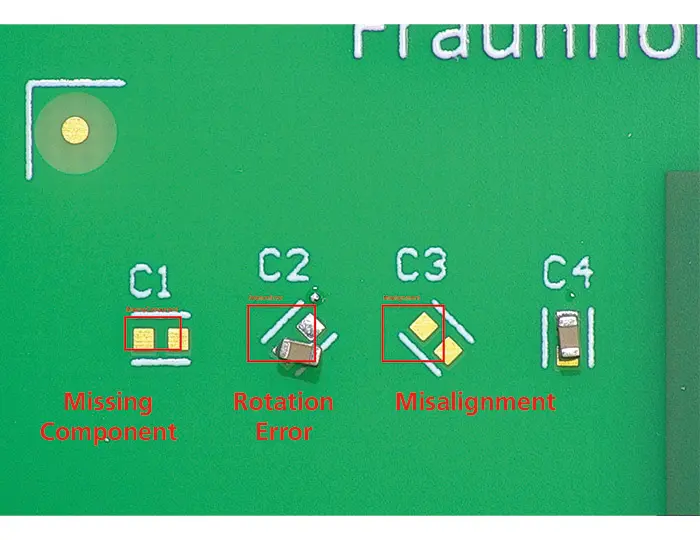

Testergebnisse: Fehlererkennung im Labor

Der Workflow wurde an der Prototypen-Linie der Start-a-Factory am Fraunhofer IZM getestet. Dafür kamen zehn Test-Leiterplatten (60 mm × 60 mm) mit gezielt eingebauten Platzierungs- und Druckfehlern zum Einsatz, um eine repräsentative Bandbreite an Fehlerkategorien abzudecken. Das RAG-gestützte VLM-Modell detektierte die Defekte und lieferte eine strukturierte Ausgabe der Fehleranalyse – von visuellen Details über die Position und den Fehlertyp.

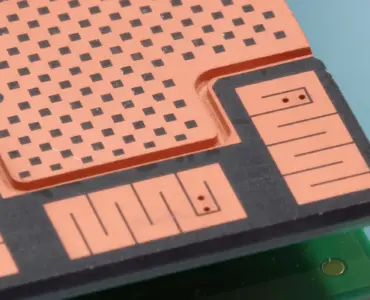

Test-Leiterplatte mit eingebrachten Druckfehlern – fehlende Komponente und Fehlausrichtung | © Fraunhofer IZM

Test-Leiterplatte: Fehlererkennung – Claude Sonnet 4.5 | © Fraunhofer IZM

Ausblick: Potenzial für Produktion und Automatisierung

Die KI-gestützte Inspektion geht über die rein regelbasierte Fehlerdetektion klassischer Inspektionssysteme hinaus. Sie erweitert diese um Flexibilität, Interpretierbarkeit und Anpassbarkeit an neue Leiterplattenlayouts. Die strukturierte JSON-Ausgabe des Modells lässt sich in die Maschinenkommunikation integrieren. So können Fertigungsprozesse wie etwa die Bestückung von PCBs und der Lotpastendruck automatisiert auf identifizierte Fehler reagieren und diese korrigieren. KI-gestützte Workflows lassen sich prinzipiell für jede Fertigungslinie anpassen.

Einsatz in der photonischen Gehäusefertigung

Dass die Forschungsarbeit in der Gruppe »Photonic and Plasmonic Systems« entstanden ist, liegt daran, dass sie zentrale Herausforderungen adressiert, die sowohl in der Mikroelektronik als auch in der photonischen Fertigung auftreten. Photonik- und Plasmoniksysteme erfordern, ähnlich wie elektronische Baugruppen, hochpräzise Herstellungs- und Montageprozesse, bei denen kleinste Abweichungen in der Bauteilplatzierung oder -klassifikation die Funktionalität erheblich beeinträchtigen können. »Der KI-Workflow für Leiterplatten lässt sich auch in der photonischen Gehäusefertigung umsetzen«, erklärt Karim Shousha.